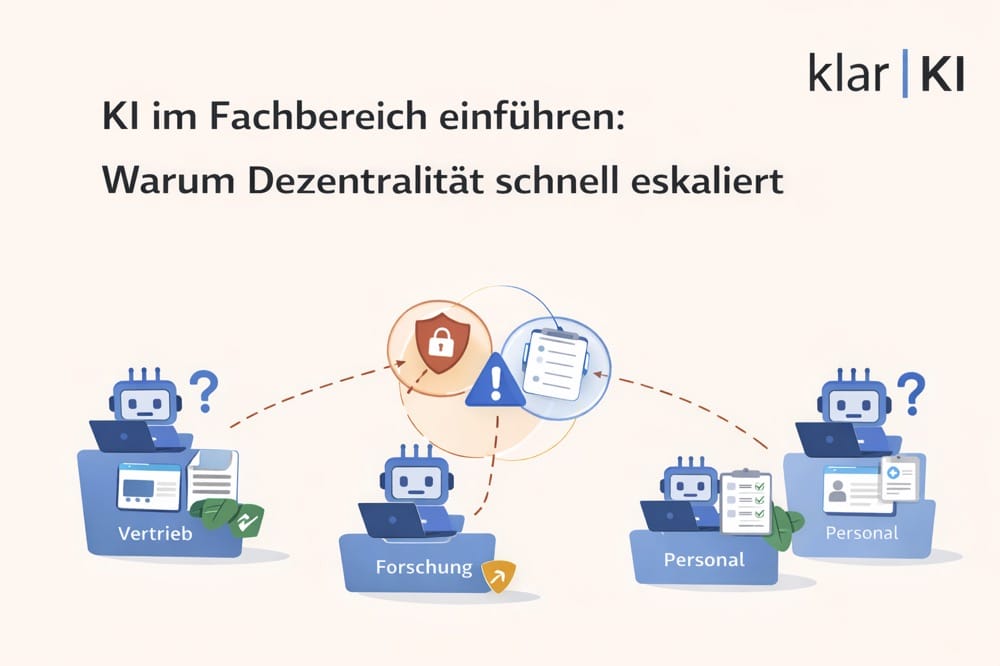

Die Marketingabteilung nutzt ChatGPT für Kundentexte. Der Vertrieb schreibt Angebote mit KI-Unterstützung. HR erstellt Stellenanzeigen per Browser-Plugin. Die IT-Leitung erfährt davon durch Zufall.

Was harmlos beginnt, wird schnell zum Risikocluster: ungeprüfte Datenflüsse, rechtlich fragwürdige Ergebnisse, keine Verantwortlichkeit. Die Fachabteilungen handeln nicht fahrlässig. Sie handeln pragmatisch. Doch Pragmatismus ohne Struktur erzeugt Schatten-IT – nicht Innovation.

Dieser Artikel erklärt, warum dezentraler KI-Einsatz eskaliert, welche Muster sich wiederholen und wie Sie Kontrolle zurückgewinnen, ohne Innovation zu blockieren.

Warum Fachabteilungen eigenständig KI einführen

Fachabteilungen warten nicht auf zentrale Freigaben. Sie haben ein Problem, finden ein Tool und nutzen es. Die Logik ist nachvollziehbar: ChatGPT ist schneller als die IT-Anfrage. Ein Browser-Plugin ist einfacher als ein internes Projekt. Die Ergebnisse sind sofort sichtbar.

Die IT-Abteilung hingegen prüft Datenschutz, Sicherheit, Integration. Das dauert Wochen. Die Geschäftsführung diskutiert Strategie, Budget, Verantwortung. Das dauert Monate. Die Fachabteilung kann nicht warten. Also handelt sie.

Dieses Muster entsteht nicht aus Ignoranz. Es entsteht aus unterschiedlichen Zeithorizonten. Marketing muss heute liefern. IT muss langfristig absichern. Beide Perspektiven sind legitim. Doch ohne gemeinsame Entscheidungslogik entsteht Parallelität, die niemand kontrolliert.

Typische Muster: Wie Schatten-IT mit KI entsteht

1. Das Browser-Plugin

Ein Mitarbeiter installiert ein KI-Plugin, das E-Mails korrigiert, Texte formuliert oder Zusammenfassungen erstellt. Die Installation erfolgt ohne IT-Freigabe. Die Daten fließen zu einem externen Anbieter. Niemand dokumentiert, welche Informationen verarbeitet werden.

2. Die kostenlose Testversion

Eine Abteilung testet ein KI-Tool mit Testversion. Die Anmeldung erfolgt mit privater E-Mail-Adresse. Unternehmensdaten werden hochgeladen, um Funktionen zu prüfen. Nach Ablauf der Testphase bleiben die Daten beim Anbieter. Niemand hat einen Vertrag geprüft.

3. Die ChatGPT-Nutzung

Mitarbeiter nutzen ChatGPT für Kundenanfragen, Vertragsformulierungen oder technische Dokumentation. Die Eingaben enthalten sensible Informationen. OpenAI speichert die Daten zur Modellverbesserung. Datenschutz wurde nicht geprüft.

Diese Muster sind kein Einzelfall. Sie sind Standard. Nicht weil Mitarbeiter unverantwortlich handeln, sondern weil keine Alternative bereitsteht. Wer schnell liefern muss, nutzt verfügbare Mittel.

Warum Verbote nicht funktionieren

Viele Geschäftsführungen reagieren mit Verboten: KI-Nutzung nur nach IT-Freigabe. Externe Tools grundsätzlich untersagt. ChatGPT gesperrt.

Das Problem: Verbote verlagern die Nutzung, sie stoppen sie nicht.

Mitarbeiter nutzen private Geräte. Sie greifen über mobile Netzwerke zu. Sie formulieren Anfragen vage, um keine direkten Unternehmensdaten preiszugeben. Die Nutzung wird unsichtbar – nicht sicherer.

Ein Verbot ohne Alternative signalisiert: Wir haben keine Antwort. Das untergräbt Glaubwürdigkeit. Mitarbeiter interpretieren es als technisches Desinteresse, nicht als Risikobewusstsein.

Wirksamer ist ein Rahmen: Was darf unter welchen Bedingungen genutzt werden? Welche Daten sind ausgeschlossen? Wer trägt Verantwortung für Ergebnisse?

Die eigentlichen Risiken dezentraler KI-Nutzung

Datenschutz und Datenflüsse

KI-Tools verarbeiten Eingaben extern. Viele Anbieter nutzen Daten zur Modellverbesserung. Das bedeutet: Kundendaten, interne Informationen, Geschäftsgeheimnisse landen auf fremden Servern. Ohne Prüfung der AGB. Ohne Auftragsverarbeitungsvertrag. Ohne Dokumentation.

Die DSGVO verlangt Transparenz. Betroffene müssen informiert werden, wenn ihre Daten verarbeitet werden. Bei dezentraler KI-Nutzung wissen Sie nicht, welche Daten wo verarbeitet wurden. Eine Auskunftsanfrage können Sie nicht beantworten.

Qualität und Haftung

KI erzeugt plausibel klingende Ergebnisse. Nicht immer korrekte. Ein Angebot mit falschen Preisen. Eine Rechtsauskunft mit veraltetem Gesetzestext. Eine Kundenkommunikation mit diskriminierender Formulierung.

Wer haftet dafür? Der Mitarbeiter, der das Tool nutzte? Die Abteilung, die es freigab? Die Geschäftsführung, die keine Richtlinie definierte?

Ohne Prüfprozess, ohne Verantwortlichkeit bleibt diese Frage offen. Im Schadensfall fehlt die Grundlage für Klärung.

Organisatorische Fragmentierung

Jede Abteilung nutzt andere Tools. Marketing arbeitet mit Tool A, Vertrieb mit Tool B, HR mit Tool C. Niemand weiß, was die anderen nutzen. Ergebnisse sind nicht vergleichbar. Prozesse sind nicht dokumentiert. Wissen bleibt in Silos.

Diese Fragmentierung erschwert spätere Vereinheitlichung. Jede Abteilung hat Gewohnheiten entwickelt. Jedes Tool hat Abhängigkeiten geschaffen. Die Integration wird zum Nachholprojekt – teurer und aufwendiger als notwendig.

Was stattdessen erforderlich ist

Entscheidungslogik vor Toolauswahl

Bevor eine Fachabteilung KI einführt, braucht sie Antworten auf drei Fragen:

-

Welches Problem soll gelöst werden? Nicht: "Wir wollen KI nutzen." Sondern: "Wir müssen 200 Angebote pro Woche schneller erstellen."

-

Welche Daten dürfen verarbeitet werden? Nicht: "Alle Daten, die hilfreich sind." Sondern: "Öffentlich verfügbare Informationen ja. Kundendaten nein."

-

Wer prüft Ergebnisse? Nicht: "Das macht die KI." Sondern: "Jeder KI-Text wird von einem Mitarbeiter gegengelesen."

Diese Logik muss zentral definiert werden. Nicht weil die IT alles kontrollieren soll. Sondern weil Fachabteilungen keine Datenschutzexperten sind. Sie brauchen Leitplanken, keine Mikromanagement.

Zentrale Freigabe, dezentrale Nutzung

Fachabteilungen dürfen schnell handeln. Aber nicht jedes Tool darf genutzt werden. Die Lösung: Eine zentrale Freigabeliste.

Die IT-Abteilung prüft Tools einmalig auf Datenschutz, Sicherheit, Vertragsbedingungen. Freigegebene Tools dürfen ohne weitere Rückfrage genutzt werden. Neue Tools durchlaufen einen definierten Prüfprozess.

Das beschleunigt Fachabteilungen. Es entlastet die IT. Es schafft Transparenz.

Dokumentation statt Kontrolle

Sie müssen nicht jede KI-Nutzung überwachen. Aber Sie müssen wissen, wo KI eingesetzt wird. Eine einfache Übersicht genügt:

- Welche Abteilung nutzt welches Tool?

- Für welchen Anwendungsfall?

- Welche Daten werden verarbeitet?

- Wer ist verantwortlich?

Diese Dokumentation ist keine Bürokratie. Sie ist Risikomanagement. Im Schadensfall wissen Sie, wo Sie ansetzen müssen. Bei Audits können Sie Auskunft geben. Bei Skalierung wissen Sie, welche Erfahrungen vorliegen.

Fazit

KI in Fachabteilungen einzuführen ist kein technisches Problem. Es ist ein organisatorisches. Nicht die Tools sind das Risiko. Die fehlende Entscheidungslogik ist es.

Verbote blockieren Innovation. Laissez-faire erzeugt Haftungsrisiken. Der Mittelweg: Klare Leitplanken, schnelle Freigaben, dokumentierte Verantwortung.

Sie müssen keine KI-Strategie ausformulieren. Aber Sie müssen wissen, wer was unter welchen Bedingungen entscheiden darf. Diese Klarheit entsteht nicht nebenbei. Sie erfordert eine bewusste Entscheidung.

Häufig gestellte Fragen

Bereit für klare KI-Entscheidungen?

Lassen Sie uns gemeinsam herausfinden, wie klar | KI Sie bei Ihrem KI-Projekt unterstützen kann.

Erstgespräch anfragen