Warum unsaubere Anforderungen KI-Ergebnisse unbrauchbar machen

Viele Unternehmen stellen nach ersten KI-Einsätzen fest, dass die Ergebnisse nicht verwertbar sind. Die häufigste Reaktion: bessere Prompts schreiben, ein anderes Modell ausprobieren, die Eingaben anpassen. Was dabei übersehen wird: Das Problem liegt meist nicht im Werkzeug. Es liegt in den Anforderungen – oder deren Abwesenheit.

KI-Anforderungen definieren ist keine technische Aufgabe. Es ist eine fachliche. Und sie entscheidet darüber, ob ein KI-System überhaupt etwas Verwertbares produzieren kann.

Warum dieses Problem so häufig entsteht

Der Einstieg in den KI-Einsatz folgt in vielen Unternehmen einem ähnlichen Muster: Ein Team testet ein Tool, die ersten Ergebnisse sehen gut aus, und es wird beschlossen, den Einsatz auszuweiten – auf echte Prozesse, mit echten Daten, unter echten Anforderungen.

Genau hier beginnen die Schwierigkeiten. Was im Test funktioniert hat, hält in der Breite nicht stand. Die Outputs variieren stark. Manche sind brauchbar, andere nicht – und es ist nicht klar, warum.

Das liegt daran, dass im Test keine echten Anforderungen gestellt wurden. Es wurde geprüft, ob das System grundsätzlich etwas produziert. Nicht, ob es das Richtige produziert.

Dieser Unterschied klingt trivial. Er ist es nicht.

Warum „fast richtig" bei KI nicht existiert

Klassische Software verhält sich deterministisch: gleiche Eingabe, gleiches Ergebnis. Fehlerhafte Anforderungen führen zu falschen Ergebnissen – aber konsistent falschen, die auffallen und korrigierbar sind.

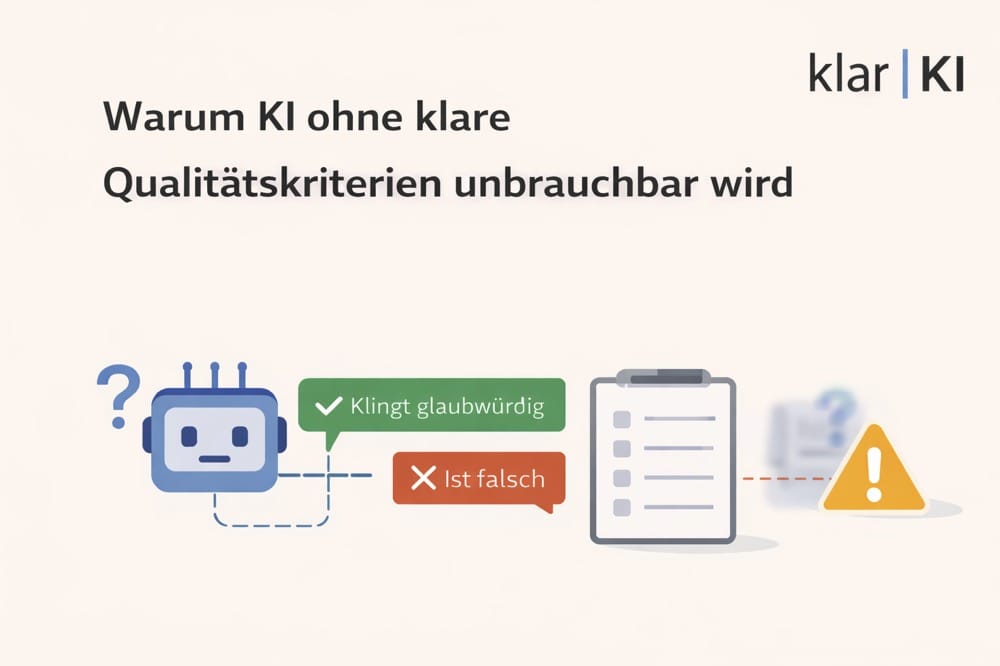

KI-Systeme verhalten sich anders. Sie erzeugen Ergebnisse, die plausibel klingen, gut formuliert sind und auf den ersten Blick überzeugen – unabhängig davon, ob der fachliche Inhalt stimmt. Das System optimiert auf sprachliche Kohärenz, nicht auf fachliche Korrektheit.

Was das bedeutet: Bei unklaren Anforderungen liefert ein KI-System nicht eine abgeschwächte Version des Richtigen. Es liefert etwas, das wie eine Antwort aussieht, aber keine ist – und das ohne erkennbare Warnung.

Für Fachprozesse ist das ein strukturelles Problem. Ein Mitarbeitender, der unsicher ist, fragt nach. Ein KI-System nicht.

Typische Missverständnisse beim Einsatz von KI in Fachprozessen

„Wir schreiben einfach bessere Prompts"

Prompt-Qualität beeinflusst die Form eines Ergebnisses. Sie ersetzt nicht das fehlende fachliche Fundament.

Ein Prompt ist die operative Umsetzung einer Anforderung – nicht die Anforderung selbst. Wer nicht präzise weiß, was fachlich korrekt ist, kann keinen Prompt formulieren, der das verlässlich sicherstellt. Prompt-Iteration ist sinnvoll, wenn die Anforderung klar ist. Ohne diese Klarheit dreht man an einem Stellrad, dessen Wirkung man nicht messen kann.

„Das System lernt mit der Zeit"

KI-Systeme ohne explizites Feedback-Training lernen nicht aus dem Einsatz heraus. Sie wiederholen dasselbe Verhalten – mit denselben blinden Flecken. Wenn die Anforderungen unklar sind, verbessert sich das Ergebnis nicht durch Nutzung. Es bleibt systematisch unzuverlässig.

„Die KI macht es so wie ein guter Mitarbeitender"

Ein erfahrener Mitarbeitender bringt Fachverständnis, Kontext und die Fähigkeit mit, Lücken zu erkennen und zu erfragen. Ein KI-System füllt Lücken – mit dem, was statistisch plausibel ist. Das ist nicht dasselbe.

Was Anforderungen bei KI tatsächlich leisten müssen

Anforderungen für KI-Einsätze sind eine Übersetzungsleistung. Sie übersetzen fachliches Wissen in eine Form, die für das System handlungsleitend ist.

Das umfasst mehr als eine Aufgabenbeschreibung. Es umfasst:

Kontext: In welchem fachlichen Umfeld findet die Aufgabe statt? Welche Rahmenbedingungen gelten?

Eingaben: Welche Daten, Dokumente oder Informationen sind typisch – und welche Ausnahmen treten auf?

Korrektheitskriterien: Woran erkennt ein Fachmensch, ob das Ergebnis stimmt? Welche Fehler sind kritisch, welche tolerierbar?

Grenzen: Was soll das System explizit nicht tun oder entscheiden?

Diese vier Dimensionen sind in den meisten KI-Projekten nicht vollständig geklärt – nicht weil die Teams nachlässig arbeiten, sondern weil das implizite Fachwissen oft nicht dokumentiert ist und die Klärung als selbstverständlich vorausgesetzt wird.

Strukturierte Einschätzung: Wo stehen Ihre Anforderungen?

Bevor KI in einem Fachprozess eingesetzt wird, lohnt es sich, drei Fragen ehrlich zu beantworten:

1. Können zwei Fachmitarbeitende unabhängig voneinander dasselbe Ergebnis als korrekt oder falsch bewerten?

Wenn nicht, fehlen explizite Korrektheitskriterien – und damit die Grundlage für jeden sinnvollen KI-Einsatz.

2. Ist dokumentiert, welche Ausnahmen und Grenzfälle im Prozess auftreten?

KI-Systeme verhalten sich an Grenzen anders als in Standardsituationen. Wer diese Grenzen nicht kennt, kann den Einsatz nicht sinnvoll einschränken.

3. Wer im Unternehmen ist fachlich verantwortlich für die Anforderungen – und für die Beurteilung der Ergebnisse?

Ohne klare Verantwortung für die fachliche Seite bleibt die Qualitätskontrolle lückenhaft.

Konkrete Empfehlungen für den Umgang mit KI-Anforderungen

Anforderungen explizit machen, bevor ein Tool ausgewählt wird.

Die Frage „Was soll die KI leisten?" muss beantwortet sein, bevor die Frage „Welches System nehmen wir?" gestellt wird. Umgekehrt führt das zu Anforderungen, die sich am Tool orientieren – nicht am fachlichen Bedarf.

Fachexperten einbeziehen, nicht nur IT.

Anforderungsklarheit ist kein technisches Problem. Sie entsteht im Dialog zwischen Fachlichkeit und technischen Möglichkeiten – und erfordert, dass beide Seiten an einem Tisch sitzen.

Korrektheitskriterien dokumentieren.

Für jeden Prozessschritt, in dem KI eingesetzt werden soll, sollte schriftlich festgehalten sein: Was ist ein gutes Ergebnis? Was ist ein inakzeptables Ergebnis? Ohne diese Dokumentation gibt es keine Grundlage für Qualitätskontrolle.

Piloten mit realen Qualitätsmaßstäben auswerten.

Testphasen sollten nicht nur messen, ob das System etwas produziert, sondern ob die Ergebnisse den fachlichen Anforderungen entsprechen – beurteilt von Fachexperten, nicht nur von IT.

Anforderungslücken als Investitionsentscheidung behandeln.

Wenn die Anforderungen nicht ausreichend klar sind, ist das kein Hindernis, das sich im Projektverlauf von selbst löst. Es ist ein Risiko, das explizit adressiert werden muss – bevor Ressourcen in Implementierungen fließen.

Fazit

Unsaubere Anforderungen sind kein Randproblem im KI-Einsatz. Sie sind einer der häufigsten Gründe, warum KI-Ergebnisse in der Praxis nicht verwertbar sind – und warum Projekte, die technisch funktionieren, fachlich scheitern.

Das lässt sich nicht durch bessere Tools lösen. Es lässt sich lösen, indem die Anforderungsarbeit ernst genommen wird – als eigenständiger Schritt, bevor Implementierungsentscheidungen getroffen werden.

Wer KI-Anforderungen definieren will, braucht keine Technologieexpertise als erstes. Er braucht Klarheit darüber, was fachlich korrekt ist, wer das beurteilt und welche Grenzen gelten. Das ist eine Managementaufgabe – keine IT-Aufgabe.

Häufig gestellte Fragen

Bereit für klare KI-Entscheidungen?

Lassen Sie uns gemeinsam herausfinden, wie klar | KI Sie bei Ihrem KI-Projekt unterstützen kann.

Erstgespräch anfragen